La Agencia de Protección de Datos investiga ChatGPT: ¿Qué riesgos conlleva su uso para nuestra privacidad?

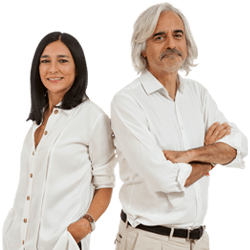

El abogado experto en tecnología y protección de datos, Efrén Díaz, detalla los aspectos de esta inteligencia artificial que han provocado la alarma en algunas instituciones

Audio

Tiempo de lectura: 3'

Actualizado 15 abr 2023

Los móviles, los asistentes de voz, o los motores de búsqueda en Internet utilizan la inteligencia artificial. Una tecnología que se sigue perfeccionando y tiene en ChatGPT a su máximo exponente. Esta herramienta, creada por la empresa estadounidense OpenAI, es capaz de redactar desde un correo de respuesta hasta un poema o un trabajo académico.

El proceso para hacerlo, además, se caracteriza por su sencillez: solo hay que registrarse en su web, acceder con nuestra cuenta y aparece un chat al que se le puede pedir prácticamente cualquier cosa y, lo mejor de todo, responde en pocos segundos y de una forma bastante coherente, casi como si lo hubiera hecho un ser humano.

A pesar de la avalancha de usuarios que empezaron a usarlo en sus primeros días de vida, ChatGPT ha suscitado polémica desde sus inicios. Tanto es así que se ha llegado a prohibir su uso en colegios y universidades de todo el mundo. Más recientemente, ha surgido el debate sobre cómo se puede regular esta herramienta tan poderosa. La Agencia Española de Protección de Datos ha decidido investigar a OpenAI, la compañía que la ha desarrollado, por una posible vulneración de la protección de datos. Pero no somos los únicos: Italia ya ha vetado el uso de ChatGPT desde finales de marzo, y Estados Unidos y China también están planteándose regular de alguna manera estos programas basados en la inteligencia artificial.

Efrén Díaz, abogado experto en tecnologías emergentes, privacidad y protección de datos, deja claro que este debate ya a nivel gubernamental es diferente al que se generó simplemente en el ámbito educativo en los comienzos de la plataforma. "El reglamento europeo de protección de datos protege a la persona en lo que se refiere al procesamiento, y ChatGPT genera un procesamiento masivo de estos datos que puede llegar a comprometer seriamente la privacidad".

La diferencia entre esta herramienta y lo que hacen ya desde hace un tiempo las redes sociales, por ejemplo, en cuanto a recopilación de nuestros datos, es precisamente ese procesamiento masivo de información obtenida de la red y la inseguridad que eso puede conllevar. "Según lo que ha publicado el garante de protección de datos italiano, que fue el que comenzó las investigaciones a nivel europeo, la causa ha sido una brecha de seguridad que dejó al descubierto datos de los propios usuarios de ChatGPT", explica el abogado, que apunta que incluso quedaron a la vista datos bancarios de estos usuarios. Esta brecha ha provocado que las instituciones italianas se pongan manos a la obra para investigar el sistema e intentar ponerle coto.

Aparte de esto, ChatGPT no pide consentimiento expreso a los usuarios de los que obtiene información y no los discrimina tampoco por edad, tal y como indica Efrén Díaz. Estos dos aspectos también encendieron las alarmas de las autoridades italianas, que finalmente han optado por bloquear la web de la herramienta dentro de sus fronteras, "en aras de velar por su legalidad y porque puede haber unos incumplimientos muy graves en ese procesamiento de datos", señala el experto. "Veremos qué medidas determinará cada Estado".

¿Habrá que legislar el uso de la inteligencia artificial?

Se trata de una tecnología que está avanzando a pasos agigantados, tanto que hace unas semanas científicos de todo el mundo llegaron a la conclusión de que se debe frenar un poco la evolución de ChatGPT. Aún así, Efrén Díaz cree que "puede tener un efecto positivo" pero, por supuesto, "habrá que ver cómo se aborda". En este sentido, el abogado comenta que la Unión Europea ya se encuentra preparando los textos de lo que será la normativa reguladora de la inteligencia artificial dentro de sus fronteras.

Esta futura normativa recogerá, según cuenta Efrén Díaz, el concepto de 'riesgo inaceptable', que será cuando la herramienta "afecte a derechos y libertades de los ciudadanos". No obstante, el abogado aclara que con este riesgo inaceptable la Unión Europea no pretende prohibir ChatGPT o cualquier otra herramienta de inteligencia artificial, sino que es una tecnología que "está abierta a su desarrollo" y que "supone un riesgo", por lo que establecerá unas medidas para evitarlo o mitigarlo.

- Left6:No existe configuración de publicidad para el slot solicitado

- item no encontrado